06.12.2019

Tradition vs. Innovation

1. Teil: „Die Storage-Konzerne suchen neue Wege “

Die Storage-Konzerne suchen neue Wege

Autor: Hartmut Wiehr

Shutterstock / Gorodenkoff

Cloud, Big Data und Machine Learning stellen immer höhere Ansprüche an die zugrundeliegende Storage-Technologie. Ein Blick auf den Markt verrät, was Unternehmen über Storage-Hersteller wissen müssen.

Am Ende des Tages müssen all die Daten, die von der Digitalisierung produziert werden, irgendwo gespeichert werden – und möglichst in Echtzeit verarbeitet und bereitgestellt werden als Basis für die mit großen Hoffnungen beschworenen neuen Business-Chancen. Deshalb hat die Bedeutung der Storage-Abteilungen in den Unternehmen in den vergangenen Jahren stark zugenommen. Gleichzeitig war der Storage-Markt von starken, technologisch getriebenen Verwerfungen gekennzeichnet. Neue Technologien wie Flash oder NVMe haben bis dato fest vorgegebene Grenzen aufgeweicht und den Markt kräftig durcheinandergewirbelt. Nicht alle Größen von einst sind noch in alter Frische und Größe präsent, und ganz neue Anbieter haben sich Spitzenplätze bei Know-how und Umsatz erkämpft. Zeit für eine Zwischenbilanz.

Markt im Umbruch

Gartner zufolge zählt Storage zu den sechs wichtigsten Anforderungen für Unternehmen. Speicherlösungen müssen mit dem Datenwachstum mithalten, leicht und kostengünstig zu erweitern sein und zugleich Techniken der Datenreduktion wie Deduplizierung und Komprimierung beherrschen. Die Speichermedien – ob Festplatte, Flash oder Tape – sollen nur noch eine untergeordnete Rolle spielen und die Übergänge in Hybrid- oder Multi-Clouds möglichst flexibel sein. Das stellt die Anwenderunternehmen vor die Frage, mit welchen Produkten und Services und nicht zuletzt mit welchen Herstellern sie zusammenarbeiten sollen.

Die Antwort wird durch die zunehmende Komplexität auf dem Storage-Markt erschwert. Schon bei den traditionellen Lieferanten ist die Lage wegen zahlloser interner Umstrukturierungen und vieler Zu- und Verkäufe sehr unübersichtlich geworden. Hinzu kommt: Alle großen Storage-Hersteller befinden sich in einer Art Abwehrkampf gegenüber einer breiten Front kleinerer Start-ups, aus denen heute meist die Innovationen hervorgehen, deren Zukunft aber im Einzelnen kaum seriös prognostiziert werden kann. Außer der Übernahme kommen dabei Formen der Kooperation zum Einsatz wie Vertriebsabkommen, OEM-Lösungen (Produktverkauf unter eigenem Namen), Finanzierung oder Unterstützung durch große Reseller und Distributoren wie Tech Data.

Kaminario und StorONE etwa wären ohne die Unterstützung von Tech Data vielleicht schon wieder vom Markt verschwunden. Anders gesagt: Die weltweiten Vertriebsmöglichkeiten von Tech Data eröffnen ihnen die Chance zum Überleben im Haifischbecken der Storage-Start-ups. Kaminario-CEO Dani Golan, ein ehemaliger israelischer Luftwaffenkommandeur, erklärte im Juni 2019 freimütig vor Journalisten: „Kennen Sie ein einziges Storage-Start-up, das sich aus eigener Kraft erfolgreich am Markt durchsetzen konnte?“

Immerhin, ein paar scheinen es geschafft zu haben, eine eigenständige Rolle zu spielen – etwa Nutanix oder Pure Storage, die manchmal sogar schon zum Club der Großen gerechnet werden. Aber ob sie schon verlustfrei operieren und ihre Investoren auszahlen konnten, bleibt ihr Geheimnis. Tatsache ist: Viele Kunden von IBM, EMC oder NetApp sind zu ihnen abgewandert, weil sie sich von den Etablierten nicht mehr angemessen und individuell behandelt fühlten.

Im Folgenden wirft com! professional einen Blick auf die Entwicklung bei den großen Storage-Herstellern, auf ihre Strategien und Roadmaps – alles Unternehmen mit großer Vergangenheit, aber unsicherer Zukunft.

2. Teil: „IBM – der tastende Gigant“

IBM – der tastende Gigant

Mit über 350.000 Angestellten – nach einem Peak von 434.000 im Jahr 2012 – zählt IBM immer noch zu den ganz Großen im IT-Business. In den vergangenen Jahren hat IBM vor allem unter den CEOs Samuel Palmisano und Virginia Rometty diverse Versuche hinter sich gebracht, eine neue Orientierung für sein Geschäft zu finden. Auf der einen Seite stehen der Verkauf der PC- und Notebook-Produktion an den chinesischen Konkurrenten Lenovo, die Aufgabe der Midrange-Server-Umgebung AS/400 und der schleichende, bis auf den heutigen Tag offiziell aber geleugnete Rückzug aus dem Mainframe-Geschäft. Auf der anderen Seite gab es immer neue Zukäufe und Investitionen bei Services, Software, Cloud-Computing und Open Source. Einige dieser Akquisitionen hat IBM sich richtig viel Geld kosten lassen (müssen): Netezza kostete 1,7 Milliarden Dollar, Sterling 1,4 Milliarden, SPSS 1,2 Milliarden, SoftLayer 2 Milliarden und Red Hat zuletzt sage und schreibe 34 Milliarden Dollar.

Storage war über Jahrzehnte – sowohl hardware- wie softwareseitig – ein wichtiger Posten im Produktportfolio von IBM. Mit Innovationen bei Festplatten, Tapes und Storage-Software gab der Konzern lange den Ton an. Auch fehlte es nicht an Investitionen in diesen klassischen IT-Bereich – sogar etwas gegen den Trend. Selbst in Speicher-Hardware hat IBM investiert: 2012 wurde Texas Memory Systems (Solid State Storage) übernommen, vorher schon 2008 XIV (Enterprise-Hardware) und 2010 Storwize (Midsize-Hardware einschließlich Software-Funktionen wie Komprimierung). 2015 kam Cleversafe als Anbieter von objektbasierter Storage-Software hinzu (Kaufpreis: 1,39 Milliarden Dollar).

Eine geradlinige Strategie ist das nicht unbedingt. Es macht eher den Eindruck, als wolle der Konzern bei Storage Präsenz zeigen und bestehende Kundenkontakte pflegen. Der Kontakt zu den Resellern wird sorgfältig und teils immer noch im luxuriösen Stil besserer Zeiten aufrechterhalten. So kamen etwa auf einer exklusiven Veranstaltung im April 2019 aus ganz Europa eingeflogene Kunden und Reseller zusammen, um zuerst in der mondänen Villa Miani auf einem der Hügel Roms ein wenig Produktpräsentation über sich ergehen zu lassen. Abends ging es dann in das angemietete Kapitolinische Museum – mit Führungen durch die Altertümer und Abendessen auf der Terrasse. So eine üppige (und teure) Kontaktpflege leisten sich heutzutage nur noch wenige IT-Hersteller. Anlass war lediglich ein neues Release von Spectrum Scale, der Management-Lösung für Shared-Disk-Dateien auf verschiedenen Servern, einer Weiterentwicklung und Umfirmierung des IBM General Parallel File Systems (GPFS).

Während das IBM-Speicher-Portfolio weitgefächert und vor allem für Bestandskunden interessant ist, haben sich die Hoffnungen in einige der größeren Akquisitionen der Vergangenheit nicht erfüllt. So zog sich Moshe Yanai, der in der Speicherbranche aufgrund vieler Erfindungen und Patente berühmte Gründer von XIV, schon bald nach dem Verkauf seines Start-ups an IBM wieder zurück und nahm einige seiner Ideen (und ein paar Millionen Dollar) in seine nächste Neugründung Infinidat mit. Andere ehemalige XIV-Mitarbeiter sind seinem Beispiel gefolgt und haben das Start-up E8 ins Leben gerufen. Und Gal Naor, der Gründer von Storwize, hielt es nach der Übernahme durch IBM ebenfalls nicht lange bei der neuen Muttergesellschaft. Auf Präsentationen seiner Neugründung StorONE spricht er (wie auch ehemalige XIV-Mitarbeiter) nicht gerade freundlich über die „Nicht-Integration“ ins IBM-Speicher-Portfolio – ein Phänomen, das viele oft sehr teure Übernahmen in der IT-Industrie kennzeichnet. Interne Konkurrenz zwischen alten Produktabteilungen, die in eine Art Abwehrkampf eintreten, Abwanderung von Mitarbeitern der gerade eingekauften kleineren Firma, die sich in dem riesigen neuen Mutterkonzern mit seinen internen Strukturen und Verhaltensweisen nicht zurechtfinden oder nicht in ein anderes Land umziehen wollen, gehören fast schon traditionell zu den Folgen von Akquisitionen. Und manches Mal wird auch nur ein unliebsamer Konkurrent vom Markt weggekauft.

Sieht man sich den Quartalsbericht von IBM für das vierte Quartal 2018 an, fällt besonders auf, dass der Hardware-Bereich („Systems Hardware“) im Jahresvergleich 23 Prozent weniger Umsatz zu verzeichnen hatte. Besonders stark mit 44 Prozent sind die Mainframe-Umsätze gesunken, während die Verkäufe von Storage-Hardware um 7 Prozent zurückgingen. Und der gesamte Bereich Hardware als solcher findet sich bezeichnenderweise nicht mehr in den aktuellen „Total Strategic Imperatives“, zu denen Analytics, Cloud (und Cloud as a Service), Mobile, Security und Social zählen.

Die Umstrukturierung des Konzerns ist also noch in vollem Gang, Software und Services dominieren immer mehr, Storage wird für das Business von IBM immer uninteressanter. Der Anteil von IBM am weltweiten Storage-Markt für Unternehmen beträgt denn auch nur noch 2,5 Prozent. Der Tag, an dem die Führung von IBM auch diesen Geschäftsbereich komplett aufgibt, dürfte nicht mehr allzu weit entfernt sein.

3. Teil: „HPE – der gespaltene Riese“

HPE – der gespaltene Riese

HPE gehört nach der Aufspaltung des alten HP in die selbstständigen Konzerne HP (Verbraucher, KMUs) und HPE (Business-IT) zu den Anbietern, die seit Jahren nur noch mit zugekauften Storage-Technologien glänzen: Dazu gehören 3PAR Storage mit High-End-Features (2010), SimpliVity mit Hyper-converged Infrastructure (2017) und Nimble Storage mit Flash-Speicher und softwaregestützter Selbstregulierung der Systeme (Predictive Analytics), ebenfalls 2017. Im Jahr 2019 wurden diese Aktivitäten flankiert durch die Übernahme des Supercomputer-Marktführers Cray, der eine solide, alteingesessene Kundenbasis bei Konzernen und Regierungsinstanzen in den USA mit einbrachte. HPE hat heute etwa 60.000 Mitarbeiter, bei HP sollen es an die 55.000 sein.

Frühere, sich teilweise überschneidende HP-Akquisitionen – Compaq (2002), 3Com (2010), Palm (2010) oder Autonomy (2011) – waren alle keine Glanzstücke. Die eher vorsichtige Akquisitionspolitik bei Storage scheint sich dagegen bewährt zu haben, auch wenn viele Kritiker monieren, dass HPE aus eigener Kraft nicht mehr zu technischen Höchstleistungen in der Lage sei. Bei Nimble Storage forciert HPE das Go-to-Market nun durch weltweit angelegte, aufwendige Marketing-Kampagnen. Zugute kommt HPE dabei, dass Nimble tatsächlich ein Alleinstellungsmerkmal hat, das andere Hersteller im Storage-Sektor bisher nicht in der gleichen Qualität vorweisen können: Self-Monitoring-Funktionen für Storage-Systeme, die eine Art Selbstheilung und intensive Support-Aktionen anstoßen können.

Dell EMC – der Wankelmütige

Unternehmerisches Hin und Her auf der Ebene des Top-Managements charakterisiert auch die Politik des Computing- und Storage-Superkonzerns Dell EMC: Aufstieg aus einer Studentenbude im texanischen Austin mit einem neuartigen Build-to-Sell-Modell im Direktvertrieb, Akquisitionen und neue Geschäftsbereiche bis hin zur EMC-Übernahme (eigentlich die größere Firma von beiden), Privatisierung angesichts der geplanten internen Umbau- und Integrationsprozesse – keine Vierteljahresberichte mehr, keine Einblicke nach innen und keine Interventionen von Investoren – und schließlich nach fünf Jahren und ständigem Eigenlob („Wir sind das größte privat gehaltene Unternehmen der Welt“) eine vergleichsweise still und leise durchgezogene Rückkehr zur Aktiengesellschaft.

Durch den Kauf von EMC hat Dell auf dem Storage-Markt gute Karten – sprich ein breites Produktportfolio plus internationale Kundenbasis. Und mit VMware, der offiziell nach wie vor unabhängigen Tochtergesellschaft, einen Virtualisierungs- und Cloud-Player, der die einstige Kerntechnologie der virtuellen Maschinen konsequent von Computing in Richtung Netzwerke, Speicher und Cloud ausgebaut hat. VMware leistet sich darüber hinaus ein sonst in der Branche nicht mehr übliches Research- und Development-Programm: Auf den jährlichen RADIO-Konferenzen (Research And Development Innovation Offsite) treffen sich VMware-Entwickler und -Produktstrategen aus allen Erdteilen – dieses Jahr waren es in San Francisco 1800 Mitarbeiter, die tagelang Ideen austauschten, diskutierten und gemeinsam an neuen Projekten arbeiteten, gut abgeschirmt vor den Augen einer Handvoll Journalisten. Immerhin konnte com! professional dabei beobachten, dass sich die Dell-Tochter dieses Event weiterhin viel Geld kosten lässt und dass in der Tat ein reger Austausch vor Ort stattfand – an dem auch das Top-Management in Gestalt von Michael Dell, Pat Gelsinger, Jeff Clarke und anderen aktiv teilnahm. RADIO ist sicher ein wichtiger Faktor für den anhaltenden Erfolg von VMware.

Dell EMC spielt nach der Fusion in einer neuen Liga und muss sich deshalb auch neuen Vergleichen stellen. Das Produkt-Portfolio ist in einer Breite aufgestellt, die an das alte IBM erinnert oder auch an Oracle und Microsoft, die als reine Software-Companys gestartet sind und sich sukzessive in andere Bereiche wie Storage oder Cloud eingekauft haben. Cisco ist ein ähnlicher Fall mit seinem Weg vom reinen Networking hin zu Servern und Storage.

Auf der „Dell Technologies World“, die Ende April wie früher die großen EMC-Veranstaltungen in Las Vegas stattfand, präsentierte Gründer und CEO Michael Dell den Konzern als Hersteller, der einige Geschäftsfelder abgestoßen und andere hinzugekauft und den Wechsel von Going Private und zurück zu Going Public erfolgreich hinbekommen hat.

Die ehrgeizigen Pläne, der tonangebende Provider von wesentlichen Infrastruktur-Komponenten der IT zu sein, scheinen Wirklichkeit zu werden: Dell EMC liefert Computer- und Storage-Hardware, System-Software sowie Services „from the edge to the core to the cloud“ und ist insgesamt der Storage-Marktführer. Eine Herausforderung für das gemeinsame Unternehmen Dell EMC, in dem auch VMware wegen seiner Technologiestärke und seiner Kundenbasis eine wichtige Rolle spielt, stellt jedoch der Abbau der noch bestehenden Schuldenlast aus der EMC-Übernahme dar, die von ursprünglich 67 auf gegenwärtig immer noch stattliche 39,3 Milliarden Dollar abgetragen werden konnte. Das bedeutet für alle Dell-Teile einen konstanten finanziellen Druck nach innen und eine Zurückhaltung bei spektakulären Akquisitionen – wo doch gerade das Feld der Storage-Start-ups einiges zu bieten hätte.

4. Teil: „NetApp – Storage pur“

NetApp – Storage pur

Zu den Big Five der Storage-Branche zählt auch NetApp, das neben Hitachi Vantara der einzige Hersteller aus dieser Gruppe ist, der außer Storage-Hardware und Storage-Software keine anderen Technologie-Produkte entwickelt, produziert und verkauft (was aber den Vertrieb von Third-Party-Angeboten nicht ausschließt). Als One-Technology-Company lassen sich Verluste nicht so gut verstecken wie bei anderen Konzernen. Nach zwei positiven Jahren zeigte das im April beendete Geschäftsjahr 2019 rückläufige Einnahmen, allerdings noch immer einen Gewinn. Laut NetApp war der Markt für traditionelle Storage-Hardware rückläufig, während die Umsätze bei Flash-Speicher und Cloud-Services positiver ausfielen. Konsequenz: Entlassungen beim Vertrieb.

Auf der Produktseite baut NetApp – wie alle großen Konkurrenten auch – das Angebot in Richtung Hybrid- und Multi-Cloud aus. Die Anwender sollen die (in etwa gleichartigen) Leistungen On-Premise, aus einer Cloud oder aus mehreren Clouds beziehen können. Das ist heute nichts Außergewöhnliches mehr – auch dass die Bezahlmodelle sich an denen aus der Cloud orientieren. Besonderen Wert legt NetApp deshalb nun auf Artificial Intelligence (AI), wobei es sich auf Container und die Open-Source-Cloud-Orchestrierungs-Lösung Kubernetes konzentriert. Die Produkte NetApp Kubernetes Service (NKS) und Cloud Volumes sollen den Unternehmen helfen, dauerhafte Storage-Lösungen umzusetzen.

„Wie Unternehmen in IT-Ressourcen investieren und diese nutzen, verändert sich laufend. Die hybride Multi-Cloud ist eindeutig der neue Standard für IT-Architekturen“, begründet George Kurian, CEO von NetApp, die Ausrichtung auf Cloud-Technologie. „NetApp bereitet sich mit seiner Data-Fabric-Strategie bereits seit Jahren auf diese Veränderung vor. Wir verfügen über enge Partnerschaften mit den größten Cloud-Providern und eine langjährige Führungsposition im Bereich Storage und Datenmanagement. Unser bahnbrechender Ansatz zur Erstellung von hybriden Multi-Cloud-Umgebungen mit Kubernetes und fortschrittlichen Daten-Services ist ein weiterer Meilenstein.“

Ausbauen möchte NetApp insbesondere die Zusammenarbeit mit den Cloud-Hyperscalern AWS, Google Cloud Platform und Microsoft Azure. Das dort übliche Bezahlen nach Nutzung und anderen zeitlichen Kriterien will NetApp schrittweise auf seine Bestandskunden mit ihren eigenen Rechenzentren übertragen – Marketing-Spruch: „Bezahlen wie in der Cloud“.

5. Teil: „Hitachi Vantara – Japan-Mix“

Hitachi Vantara – Japan-Mix

Hitachi Vantara – ein Zusammenschluss von Pentaho, Hitachi Data Systems/HDS und Hitachi Insight Group – führt die Speicheraktivitäten des japanischen Mischkonzerns Hitachi fort. Auch hier ist die Lage von Umstrukturierungen gekennzeichnet, bei denen der Bereich Storage im Gesamtkonzern deutlich an Bedeutung einbüßt. Laut Hitachi stehen die Unternehmen vor der Herausforderung, Strategien für Probleme bei Datensicherheit, IoT und der Analyse unstrukturierter Daten zu finden. Eine Lösung dafür seien moderne Speichertechniken wie All-Flash und Object Store. Laut Hitachi unterstützen seine Virtual Storage Platforms (VSP) alle SSD-Varianten sowie die Eigenentwicklung Flash Module Drive (FMD) mit eingebauter Komprimierung. Außer mit diversen Hypervisoren arbeiten die VSP-Systeme auch mit Container-Technologien wie Docker zusammen. Darüber hinaus hat Hitachi Treiber für OpenStack veröffentlicht. Die Gartner-Analysten heben hervor, dass Hitachi VSP den direkten Zugang zu Public Clouds wie AWS und Microsoft Azure ohne zusätzliche Gateways unterstütze. Anwender müssten sich aber der Umstrukturierungsphase bei Hitachi bewusst sein.

Fujitsu – Aus für Made in Germany

Zum Abschluss noch ein Blick auf einen Hersteller mit sehr ungewisser Zukunft, der in Deutschland lange eine besondere Rolle gespielt hat: Fujitsu Technology Solutions. Auch die IT-Tochter des japanischen Technologie-Konzerns ist stark von internen Veränderungen betroffen. Schönfärberisch heißt es zwar, man verstärke die Vertriebsorganisation in Europa, in der Praxis werden aber einschneidende Veränderungen vorgenommen: Das lange als Beweis der besonderen Fujitsu-Strategie gepriesene Werk in Augsburg wird geschlossen, von 1800 Mitarbeitern werden nur 350 in einem Service-Zentrum weiterbeschäftigt – kein „Made in Germany“ mehr.

Insider-Gerüchte, die auch com! professional erreicht haben, wonach sich Fujitsu aus der kompletten Hardware-Produktion zurückziehen wolle, werden zurzeit (noch) dementiert. „Wir sind zukunftsorientiert unterwegs“, erklärte noch im Mai in schönstem Manager-Deutsch Rupert Lehner, seit Mitte 2018 Chef der Vertriebsregion Central Europe. Und diese Zukunft solle in Management-Lösungen für Cloud-Umgebungen liegen.

Fujitsu-Kunden können statt ins eigene Rechenzentrum und Storage-Infrastruktur zu investieren inzwischen auch das Eternus-Speichersystem Capacity on Demand (CoD) nutzen – also monatlich für die tatsächliche Inanspruchnahme der Speichergeräte bezahlen. Damit zieht Fujitsu gleich mit AWS, Google und Azure, in der Hoffnung, Kunden zurückzubekommen oder erst gar nicht ziehen lassen zu müssen. Doch die Repräsentanz des Herstellers in Amerika und in Europa in puncto Storage ist nach wie vor schwach. Das Geschäft mit den Mainframe-Bestandskunden soll noch immer etwa 95 Prozent des Umsatzes in Central Europe ausmachen. Storage rangiert bei Fujitsu in Europa unter ferner liefen.

6. Teil: „Fazit & Ausblick“

Fazit & Ausblick

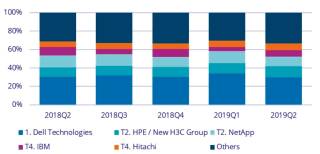

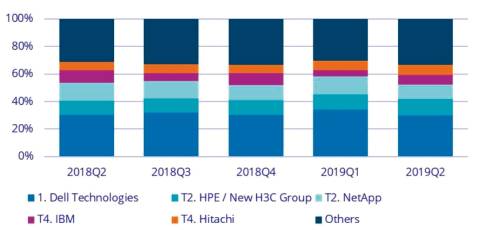

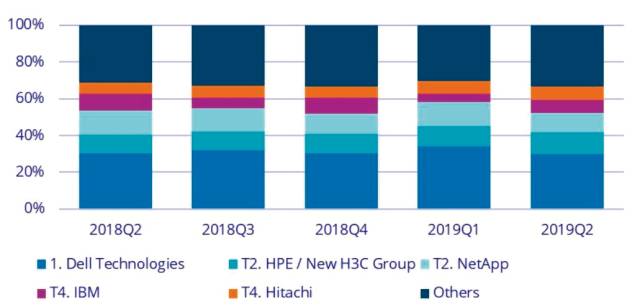

IDC liefert aufschlussreiche Zahlen über den weltweiten Speichermarkt: Bei den externen Speichersystemen (einschließlich OEM-Aufträgen) ist der Umsatz im zweiten Vierteljahr 2019 im Vorjahresvergleich um 0,8 Prozent zurückgegangen, während der Rückgang im ersten Quartal 0,6 Prozent betrug. Es ist also weiter bergab gegangen, vor allem wenn man bedenkt, dass der Umsatzrückgang einhergeht mit wachsenden verkauften Kapazitäten. Das bedeutet, dass sich höhere Kapazitäten zu niedrigeren Preisen verkaufen. Das Verhältnis Kosten zu Ertrag verschlechtert sich damit konstant seit Jahren und kann nur durch gesteigerte Produktivität oder günstigere Rohstoffe gebremst oder wieder verbessert werden.

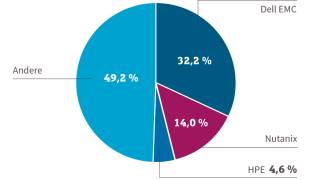

Während das Marktsegment externer Speicher bei rund 22 Prozent der gesamten Speicherinvestitionen der Unternehmen liegt, machen die serverbasierten Systeme (Server mit integriertem Speicher) derzeit etwa 7 Prozent des Speicherumsatzes aus. Man spricht hier auch von Hyper-converged Storage oder Hyper-converged Infrastructure HCI) – einem Bereich, der von Dell EMC dominiert wird (circa ein Drittel dieses Marktes). IDC, Gartner und Forrester sind unisono der Ansicht, dass es hier mit Nutanix ein Start-up auf den zweiten Platz geschafft hat – etwa 15 Prozent Marktanteil, gefolgt von HPE mit rund 5 Prozent. Auch Netzwerkhersteller Cisco beansprucht inzwischen, hier mitzumischen. Analysten prognostizieren Hyper-converged Infrastructure eine sichere Zukunft, da sie kostengünstiger als getrennte Systeme sei und sich besser den wechselnden Ansprüchen an Compute, Storage und Networking anpassen könne.

Vor diesem Hintergrund gilt als Richtschnur für Produktentscheidungen: Kunden sollten Gewicht legen auf die gute Handhabbarkeit der Produkte, das Support-Ökosystem und seine Leistungen, die Offenheit des Herstellers und seiner Auftritte, sein Partnernetzwerk inklusive OEMs, die Zusammenarbeit mit Analysten und natürlich die Preisgestaltung. Der Auftritt auf Konferenzen (eigenen und fremden) sollte genau beobachtet werden – in welchem Verhältnis stehen etwa reines Marketing und sachliche Darstellungen? Sind die Reports von Analysten gesponsert oder unabhängig erstellt?

Wer sich als Kunde für einen der großen Anbieter entscheidet, kann an sich nicht viel falsch machen. Sie alle verfügen über einen großen Apparat, viel Erfahrung und zahlreiche Kontakte zu externen Vertriebsorganisationen, Dienstleistern oder Experten. Ihre schiere Größe ist aber vielleicht nicht das Richtige für jedermann oder jedes Unternehmen: Man muss als Kunde auch mit festgefahrenen Strukturen rechnen, und schnelle Reaktionen sind nicht unbedingt immer die Stärke von allen. Dies wissen auch viele Start-ups, die oft die besseren technischen Ideen haben und denen klar ist, dass sie gut erreichbar sein müssen. Bei vielen Ausschreibungen hatten gerade die Großen das Nachsehen, weil sie hier nicht mithalten konnten. Andererseits müssen die Neuen beweisen, dass sie über stabile Strukturen und ausgeklügelte Strategien für den internationalen Markt verfügen. Es hat sich sogar schon ein Markt für Deutschland- und Europa-Spezialisten herausgebildet, die wissen, wie man neue Storage-Firmen hierzulande lanciert.

Und es gibt kleinere Firmen, die andere oder noch jüngere aufkaufen. DDN hat es mit Tintri vorgemacht, Nutanix und Pure Storage sind mit dieser Methode größer und bedeutsamer geworden. Inzwischen hat sich StorCentric zum Aufkäufer entwickelt: Die Muttergesellschaft von Drobo, Nexsan und Retrospect hat im Juli 2019 Vexata wegen seiner NVMe-Technologie übernommen.

Wer in seinem Unternehmen Wert darauf legt, die beste aktuelle Speichertechnologie einzusetzen, findet diese nicht immer bei den alteingesessenen Anbietern. Die sind sehr mit den Folgen von Übernahmen oder einem fast schon konstanten internen Umbauprozess beschäftigt. Das zieht Personalabgänge nach sich, was die Kundenbeziehungen oft negativ tangiert. Es kommt auch nicht so gut an, wenn gerade Anbieter aus den USA immer mehr Funktionen auf die Zentralen übertragen und systematisch Personal in Europa ausdünnen.

Der Storage-Markt bleibt in Bewegung, so oder so.

Smartphone-Markt

Samsung zieht wieder an Apple vorbei

Im ersten Quartal eroberte Samsung die Spitze der weltweiten Smartphone-Verkäufe von Apple zurück. Der Markt zeigte weitere Anzeichen einer Erholung.

>>

Oberklasse

Motorola zeigt die edge 50-Serie mit drei Modellen

Mit dem moto edge 50 fusion, dem edge 50 pro und dem edge 50 ultra bringt Motorola seine Smartphone-Oberklasse. Einige Varianten fallen durch ein besonderes Design und die Materialien auf.

>>

Cloud-PBX

Ecotel erweitert cloud.phone-Lösung um MS Teams-Integration

Die Telefonanlage aus der Cloud von Ecotel - ein OEM-Produkt von Communi5 - cloud.phone, ist ab sofort auch mit Microsoft-Teams-Integration verfügbar.

>>

Personalien

Komsa stellt sich im Solution-Segment neu auf

Der Distributor richtet sein UC- und Cloud-Business neu aus und stellt mit Christof Legat einen neuen Vice President UC-Solutions vor, Friedrich Wahnschaffe ist als Vice President für das MS-Cloud-Geschäft von Komsa in Deutschland verantwortlich.

>>