02.10.2019

Forschung

1. Teil: „Erkennungs-Software soll Deepfakes entlarven“

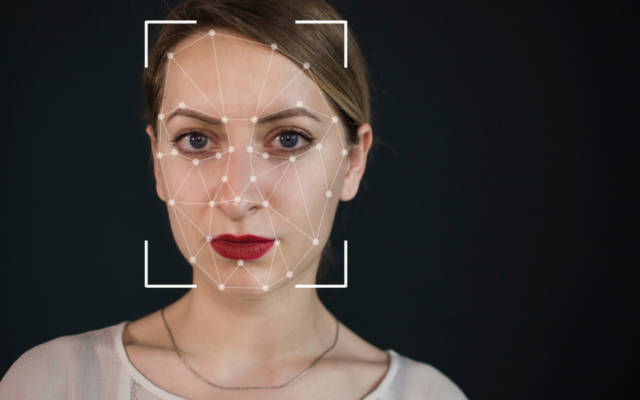

Erkennungs-Software soll Deepfakes entlarven

Autor: Jens Stark

Mihai Surdu / Shutterstock.com

Gefälschte Videos, die aber täuschend echt wirken, werden zunehmend zur Gefahr im Netz. Die ETH Lausanne will in Zusammenarbeit mit dem Start-up Quantum Integrity den sogenannten Deepfakes nun zu Leibe rücken.

Staatschefs, die andere Länder verunglimpfen, ein Firmenboss, der Beängstigendes über die Absichten seines Unternehmens "verrät": In sozialen Netzen kursieren immer häufiger täuschend echt wirkende, aber gefälschte Videos von Persönlichkeiten des öffentlichen Lebens. Solchen Deepfakes wird mittlerweile weltweit der Kampf angesagt. Unter anderen haben Microsoft und Facebook angekündigt, gut 10 Millionen Dollar in Projekte zu stecken, die Deepfakes erkennen können.

Die Zeit drängt: Denn die Fälschungen werden mit Hilfe ausgeklügelter künstlicher Intelligenz immer ausgefeilter. Trauriger Höhepunkt der Entwicklung ist die chinesische App Zao, die Ende August vorgestellt wurde und derzeit in wenigen Ländern erhältlich ist. Mit dem Programm lassen sich unter Verwendung nur weniger Fotos einer Person Deepfakes herstellen.

Den Kampf zur Erkennung der Fälschungen aufgenommen haben nun unter anderem die Multimedia Signal Processing Group der ETH Lausanne und das auf dem Campus der Hochschule angesiedelte Start-up Quantum Integrity. Die beiden entwickeln bereits seit gut zwei Jahren Verfahren zur Deepfake-Erkennung. Nun haben sie Fördermittel von Innosuisse erhalten, um ihre Erkennungs-Software zu verbessern.

"Wir sollen die Software effizienter machen, damit sie breiter angewandt werden kann", sagt Touradj Ebrahimi, Leiter der Multimedia Signal Processing Group. Seine Gruppe steuert dabei Expertise in Sachen Signalverarbeitung bei, während das Start-up seine Erfahrung in Sachen Erkennung von gefälschten Bildern einbringt.

2. Teil: „Katz-und-Maus-Spiel“

Katz-und-Maus-Spiel

Die Erkennung von Deepfakes gleicht dabei einem Katz-und-Maus-Spiel. Sobald die Wissenschaftler eine Möglichkeit entdeckt haben, woran man Deepfakes erkennt, etwa unnatürlich wirkende Lippen- oder Augenbewegungen, optimieren die "Deepfaker" ihre Algorithmen, sodass eine Erkennung schwieriger wird.

Diesen Teufelskreis wollen Ebrahimi und Anthony Sahakian, CEO von Quantum Integrity, nun durchbrechen. Allerdings verraten sie Details der zugrunde liegenden Technik noch nicht, behaupten aber, dass sie gut zwei Jahre Vorsprung gegenüber Konkurrenten besäßen. Ebrahimi verrät nur so viel, dass "die Erkennungs-Software ebenfalls auf künstlicher Intelligenz basiert, um mit den Tricks mithalten zu können, welche die Deepfake-Künstler anwenden".

So verwendet die von der ETH Lausanne und Quantum Integrity entwickelte Technik Algorithmen, die mit Hilfe von maschinellem Lernen und auf Basis einer riesigen, über Jahre gewachsenen Datenbank auf die Erkennung von Fälschungen trainiert wurden. Ziel ist es, künftig eine Webseite bereitzustellen, auf die Anwender verdächtige Inhalte hochladen und auf deren Echtheit überprüfen lassen können.

Studie

Firmen wissen mit Blockchain nichts anzufangen

Nicht einmal ein Prozent der Unternehmen im DACH-Raum sieht Möglichkeiten zur praktischen Anwendung der Blockchain-Technologie, wie eine Studie zeigt.

>>

Codeerzeugung per KI

Code ist sich viel ähnlicher als erwartet

Eine Studie zeigt, dass einzelne Codezeilen zu 98,3 Prozent redundant sind, was darauf hindeutet, dass Programmiersprachen eine einfache Grammatik haben. Die Machbarkeit von KI-erzeugtem Code war also zu erwarten.

>>

WebGPU

Sicherheitslücke in Browser-Schnittstelle erlaubt Rechnerzugriff via Grafikkarte

Forschende der TU Graz waren über die Browser-Schnittstelle WebGPU mit drei verschiedenen Seitenkanal-Angriffen auf Grafikkarten erfolgreich. Die Angriffe gingen schnell genug, um bei normalem Surfverhalten zu gelingen.

>>

Untersuchung

Amerikaner sehen KI als Risiko für Wahlen

Die Unterscheidung zwischen echten Infos und KI-Inhalten fällt vielen politisch interessierten US-Amerikanern schwer, wie eine Studie des Polarization Research Lab zeigt.

>>